HISTORIA Y EVOLUCIÓN DE LOS COMPUTADORES

Por siglos los hombres han tratado de usar fuerzas y artefactos de diferente tipo para realizar sus trabajos, para hacerlos más simples y rápidos. La historia conocida de los artefactos que calculan o computan, se remonta a muchos años antes de Jesucristo.

El Ábaco

Dos principios han coexistido respecto a este tema. Uno es usar cosas para contar, ya sea los dedos, piedras, conchas, semillas. El otro es colocar esos objetos en posiciones determinadas. Estos principios se reunieron en el ábaco, instrumento que sirve hasta el día de hoy, para realizar complejos cálculos aritméticos con enorme rapidez y precisión. En el Siglo XVII en occidente se encontraba en uso la regla de cálculo, calculadora basada en las investigaciones de varios matemáticos. John Napier (1550-1617) descubre la relación entre series aritméticas y geométricas, creando tablas que llama logaritmos. Edmund Gunter se encarga de marcar los logaritmos de Napier en líneas. Bissaker por su parte coloca las líneas de Nappier y Gunter sobre un pedazo de madera, creando de esta manera la regla de cálculo. Durante más de 200 años, la regla de cálculo es perfeccionada, convirtiéndose en una calculadora de bolsillo, extremadamente versátil. Por el año 1700 las calculadoras numéricas digitales, representadas por el ábaco y las calculadoras análogas representadas por la regla de cálculo, eran de uso común en toda Europa.

La Pascalina

La primera máquina de calcular mecánica, un precursor del ordenador digital, fue inventada en 1642 por el matemático francés Blaise Pascal. Aquel dispositivo utilizaba una serie de ruedas de diez dientes en las que cada uno de los dientes representaba un dígito del 0 al 9. Las ruedas estaban conectadas de tal manera que podían sumarse números haciéndolas avanzar el número de dientes correcto. En 1670 el filósofo y matemático alemán Gottfried Wilhelm Leibniz perfeccionó esta máquina e inventó una que también podía multiplicar.

La máquina analítica

En el siglo XIX el matemático e inventor británico Charles Babbage elaboró los principios de la computadora digital moderna. Inventó una serie de máquinas, como la máquina diferencial, diseñadas para solucionar problemas matemáticos complejos. Muchos historiadores consideran a Babbage y a su socia, la matemática británica Augusta Ada Byron (1815-1852), hija del poeta inglés Lord Byron, como a los verdaderos inventores de la computadora digital moderna. La tecnología de aquella época no era capaz de trasladar a la práctica sus acertados conceptos; pero una de sus invenciones, la máquina analítica, ya tenía muchas de las características de un ordenador moderno. Incluía una corriente, o flujo de entrada en forma de paquete de tarjetas perforadas, una memoria para guardar los datos, un procesador para las operaciones matemáticas y una impresora para hacer permanente el registro.

Primeros Ordenadores

Los ordenadores analógicos comenzaron a construirse a principios del siglo XX. Los primeros modelos realizaban los cálculos mediante ejes y engranajes giratorios. Con estas máquinas se evaluaban las aproximaciones numéricas de ecuaciones demasiado difíciles como para poder ser resueltas mediante otros métodos. Durante las dos guerras mundiales se utilizaron sistemas informáticos analógicos, primero mecánicos y más tarde eléctricos, para predecir la trayectoria de los torpedos en los submarinos y para el manejo a distancia de las bombas en la aviación.

Ordenadores electrónicos

1944 marca la fecha de la primera computadora, al modo actual, que se pone en funcionamiento. Es el Dr. Howard Aiken en la Universidad de Harvard, Estados Unidos, quien la presenta con el nombre de Mark I. Es esta la primera máquina procesadora de información. La Mark I funcionaba eléctricamente, instrucciones e información se introducen en ella por medio de tarjetas perforadas y sus componentes trabajan basados en principios electromecánicos. A pesar de su peso superior a 5 toneladas y su lentitud comparada con los equipos actuales, fue la primera máquina en poseer todas las características de una verdadera computadora. Durante la II Guerra Mundial (1939-1945), un equipo de científicos y matemáticos que trabajaban en Bletchley Park, al norte de Londres, crearon lo que se consideró el primer ordenador digital totalmente electrónico: el Colossus. Hacia diciembre de 1943 el Colossus, que incorporaba 1.500 válvulas o tubos de vacío, era ya operativo. Fue utilizado por el equipo dirigido por Alan Turing para descodificar los mensajes de radio cifrados de los alemanes. La primera computadora electrónica fue terminada de construir en 1946, por J.P.Eckert y J.W.Mauchly en la Universidad de Pensilvania, U.S.A. y se le llamó ENIAC. Con ella se inicia una nueva era, en la cual la computadora pasa a ser el centro del desarrollo tecnológico, y de una profunda modificación en el comportamiento de las sociedades. El ENIAC, que según se demostró se basaba en gran medida en el ordenador Atanasoff-Berry (en inglés ABC, AtanasoffBerry Computer), obtuvo una patente que caducó en 1973, varias décadas más tarde. El ENIAC contenía 18.000 válvulas de vacío y tenía una velocidad de varios cientos de multiplicaciones por minuto, pero su programa estaba conectado al procesador y debía ser modificado manualmente. Se construyó un sucesor del ENIAC con un almacenamiento de programa que estaba basado en los conceptos del matemático húngaro-estadounidense John Von Neumann. Las instrucciones se almacenaban dentro de una llamada memoria, lo que liberaba al ordenador de las limitaciones de velocidad del lector de cinta de papel durante la ejecución y permitía resolver problemas sin necesidad de volver a conectarse al ordenador. A finales de la década de 1950 el uso del transistor en los ordenadores marcó el advenimiento de elementos lógicos más pequeños, rápidos y versátiles de lo que permitían las máquinas con válvulas. Como los transistores utilizan mucha menos energía y tienen una vida útil más prolongada, a su desarrollo se debió el nacimiento de máquinas más perfeccionadas, que fueron llamadas ordenadores o computadoras de segunda generación. A finales de la década de 1960 apareció el circuito integrado (CI), que posibilitó la fabricación de varios transistores en un único sustrato de silicio en el que los cables de interconexión iban soldados. El circuito integrado permitió una posterior reducción del precio, el tamaño y los porcentajes de error. El microprocesador se convirtió en una realidad a mediados de la década de 1970.

ACTIVIDADES

- ¿Qué sabes del funcionamiento de un ábaco?

- ¿Sabes alguna característica de la Pascalina?

- ¿Cuál es la diferencia entre un ordenador analógico y uno digital?

- ¿Habías oído antes hablar sobre el ENIAC?

- ¿Qué son circuitos integrados?

INTRODUCCIÓN A LA INFORMÁTICA

Un sistema informático es encargado de recoger y procesar los datos y de transmitir la información. Los ordenadores son máquinas y como tales, están constituidas por elementos físicos; sin embargo, estos componentes no constituyen por si mismos un ordenador, sino que necesitan una serie de instrucciones que les hagan funcionar. Se denomina hardware al conjunto de dispositivos físicos que integran el ordenador y software al conjunto de instrucciones que dirigen los distintos componentes del ordenador para que realicen las distintas tareas. El hardware es la parte física y el software la parte lógica. Se podría decir que el hardware de un ordenador está constituido, básicamente por la Unidad Central de Proceso (CPU), que se encarga de procesar los datos, la memoria que almacena la información y los periféricos de entrada y/o salida, que permiten el intercambio de datos o información con el exterior, así como su almacenamiento.

La placa base

Al abrir un ordenador, lo primero que llama la atención es una amplia placa denominada placa base o placa madre, que actúa como una plataforma; a ella se conectan, directamente o a través de ranuras de expansión todos los demás componentes: teclado, monitor, impresora, ratón, escáner, etc.

El microprocesador

Entre todos los chips que tiene un ordenador, el microprocesador o CPU es, sin duda alguna el más importante; habitualmente se dice que es el auténtico cerebro del ordenador, ya que es el encargado de realizar todas las operaciones de procesamiento de datos, además de controlar el funcionamiento de todos los dispositivos del ordenador. La CPU no ejecuta programas ni procesa datos, los carga en la memoria RAM, y desde allí, los ejecuta o procesa. Una CPU, se compone de varias partes, que podrían resumirse en la unidad de control, encargada de dirigir todas las operaciones con las instrucciones dadas por los programas y la unidad aritméticológica, que realiza todas las operaciones, tanto las aritméticas como las lógicas.

La memoria ROM-BIOS

Este tipo de memoria, denominada ROM (Read Only Memory) es solo de lectura, es decir, no se puede escribir en ella. Contiene información grabada por el fabricante, que no desaparece al desconectar el ordenador. La ROM-BIOS es imprescindible para la puesta en funcionamiento del ordenador, ya que contiene instrucciones para realizar el chequeo inicial del ordenador, además de datos técnicos de los componentes más elementales conectados en el sistema.

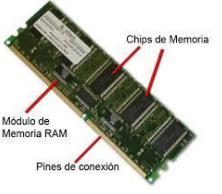

La memoria RAM

La memoria RAM (Random Access Memory) o memoria de acceso

aleatorio. El contenido de esta memoria se puede modificar, es

decir, es una memoria de lectura y escritura, pero se pierde cuando

se desconecta el ordenador. La memoria RAM almacena

temporalmente los programas o datos que se están ejecutando en el

ordenador.

Para terminar con el hardware del ordenador, quedaría ver los dispositivos de almacenamiento y los periféricos.

Dispositivos de Almacenamiento

La CPU trabaja directamente con la memoria RAM, puesto que es con ella con la que realiza el intercambio de información: toma los datos e instrucciones para ejecutarla y deja los resultados. Puesto que esta memoria es volátil, desaparece su contenido al apagar el ordenador, es imprescindible disponer de un sistema de almacenamiento que permita guardar la información de forma permanente y así, evitar su perdida

Los Periféricos

Los periféricos son dispositivos que permiten comunicar el interior del ordenador con el mundo exterior. Los periféricos pueden ser de entrada, de salida y de entrada/salida. Se denomina software al conjunto de instrucciones que permiten controlar todos los dispositivos físicos conectados a un ordenador (hardware) y realizar todas las operaciones a las que están destinados. Se puede decir que el software es la parte lógica del ordenador. Luego, todos los componentes físicos que hemos estudiado y que constituyen el hardware del ordenador funcionan gracias al software. Para estudiar el software, se suele agrupar según la función a la que está destinado. Así que podemos hablar de: Programas de aplicación: Se diseñan para satisfacer las necesidades más comunes de la gran mayoría de los usuarios. A este grupo pertenecen: Word, Excel, Access, etc… Programas multimedia: Incorporan periféricos para tratar texto, imágenes, sonido, animación y vídeo. Se incluyen aquí numerosas aplicaciones, como juegos, programas de aprendizaje, de consulta, enciclopedias virtuales, etc. Sistema operativo: Es el programa que enseña al ordenador como debe realizar todas las funciones básicas. Actúa además como intermediario entre el hardware y los programas que se ejecutan en el ordenador.

ACTIVIDADES

- ¿Qué diferencia hay entre software y hardware?

- ¿Qué significa CPU?

- ¿Qué diferencia hay entre memoria RAM y ROM?

- ¿Para qué sirven los dispositivos de almacenamiento?

- ¿Cuántos tipos de programas, hablando de software, hay?

LA INGENIERÍA INDUSTRIAL

Los ingenieros industriales han sido siempre ingenieros de integración. Mientras el rol tradicional ha sido integrar recurso humano, materiales, equipos y recursos financieros en sistemas productivos, el énfasis actual es también la integración de computadores, información y tecnología para operar y controlar sistemas complejos. En este momento existe una necesidad de ingenieros industriales que puedan manejar cambios rápidos de tecnología y altos niveles de innovación. Un ingeniero industrial observa el sistema como un todo, busca la mejor combinación de recursos humanos, recursos naturales, equipos y estructuras hechas por el hombre y construye el puente entre la Gerencia y el nivel operativo, motivando a la gente, así como eligiendo las herramientas que deben ser usadas y cómo deben ser usadas. Lo que diferencia a un ingeniero industrial de otras ingenierías es su visión más amplia.

La Ingeniería Industrial es una disciplina de gran diversidad relacionada con el diseño, mejoramiento, instalación y manejo de sistemas integrados por gente, materiales, y equipos para toda clase de productos o servicios. La amplitud de Ingeniería Industrial queda evidenciada en la gran gama de actividades en las que participa. Sus técnicas son aplicadas por ejemplo en la construcción, en las industrias de transporte, en manejo de granjas y crecimiento de cultivos, en restaurantes, en hoteles, en operación y mantenimiento de aeropuertos, en fin en cualquier organización que integre recurso humano, materiales, información y equipos. Los ingenieros industriales, actúan en cualquier sistema formado por hombres, materiales, recursos financieros y equipos, aplicando la ciencia y la tecnología para cambiar el entorno en beneficio colectivo. Es una Ingeniería de optimización de la Industria, tiene que ver con el costo, la rentabilidad, la calidad, la flexibilidad, la satisfacción de la demanda y las oportunidades.

¿Dónde participan los Ingenieros Industriales? Pueden participar en cualquier organización en donde exista la necesidad de integrar recurso humano, materiales y equipos, recursos financieros e información para mejorar sistemas productivos. Como todas las organizaciones poseen alguno de estos factores y todas quieren ser más productivas, el campo de acción del programa es muy amplio y socialmente reconocido. Un Ingeniero Industrial no solo está en capacidad de integrar estas variables, sino que puede trabajar en las áreas de las empresas en donde se desarrollen específicamente cada uno de estos aspectos.

¿Qué hace un ingeniero?

Su función principal es la de realizar diseños o desarrollar soluciones tecnológicas a necesidades sociales, industriales o económicas. Para ello el ingeniero debe identificar y comprender los obstáculos más importantes para poder realizar un buen diseño. Algunos de los obstáculos son los recursos disponibles, las limitaciones físicas o técnicas, la flexibilidad para futuras modificaciones y adiciones y otros factores como el coste, la posibilidad de llevarlo a cabo, las prestaciones y las consideraciones estéticas y comerciales. Mediante la comprensión de los obstáculos, los ingenieros deducen cuáles son las mejores soluciones para afrontar las limitaciones encontradas cuando se tiene que producir y utilizar un objeto o sistema. Los ingenieros utilizan el conocimiento de la ciencia, la matemática y la experiencia apropiada para encontrar las mejores soluciones a los problemas concretos, creando los modelos matemáticos apropiados de los problemas que les permiten analizarlos rigurosamente y probar las soluciones potenciales. Si existen múltiples soluciones razonables, los ingenieros evalúan las diferentes opciones de diseño sobre la base de sus cualidades y eligen la solución que mejor se adapta a las necesidades. En general, los ingenieros intentan probar si sus diseños logran sus objetivos antes de proceder a la producción en cadena. Para ello, emplean entre otras cosas prototipos, modelos a escala, simulaciones, pruebas destructivas y pruebas de fuerza. Las pruebas aseguran que los artefactos funcionarán como se había previsto.

ACTIVIDADES

- ¿Qué es la innovación industrial?

- ¿Qué campos de trabajo puede tocar la ingeniería industrial?

- ¿Qué son los recursos humanos y los recursos físicos?

- ¿Qué tipo de diseño hacen los ingenieros?

- ¿Conoces algún otro tipo de ingeniería además de la industrial?

LA INGENIERÍA ARTIFICIAL

¿Realidad científica o un relato de ciencia ficción?

Para adentrarnos un poco más en esto de la Inteligencia Artificial termino que muchos de nosotros hemos visto o escuchado más de una vez, tanto en cine como en algunos documentales de tv, tendríamos que remontarnos hacia la década de los 40, pero más concretamente a finales de la década de los 50. Donde John McCarthy, conocido como el padre del término IA, organizó una conferencia para todos aquellos interesados en una “maquina de la inteligencia”, aquel proyecto fue denominado “The Dartmouth Summer Research Project on Artificial Intelligence”. Tras la finalización de esta conferencia, la IA comenzó a tomar fuerza, siendo fuertemente influenciada por prestigiosas universidades como la MIT, Stanford y Carnegie-Mellon y el coloso IBM. Obviamente, todo esto produjo un interesante atractivo económico para todas ellas, acabando en importantes proyectos de investigación que poco después acabarían usándose en aplicaciones tanto civiles como militares.

Durante la década de los 80, se empezaron a obtener los primeros resultados comerciales cuando empresas como Boeing o General Motors empezaron a confiar fuertemente en sistemas informáticos que utilizaban IA. Durante los 90 la tremenda explosión que la IA produjo una década atrás, se convirtió en la inteligencia distribuida y el imaginario ser biotecnológico que se ideaba se transformó definitivamente en una inmensa red: Internet. Una poderosa y truculenta maquina engendrada por millones y millones de pequeñas redes, sistemas informáticos y billones de ordenadores personales interconectados entre sí eclosionó en un sin fin de aplicaciones, muy lejos de recordar aquellos hombres de bata blanca que solicitaban inmensas subvenciones sin apenas resultado alguno. La propia evolución tanto social como la misma complejidad de dicha red, acarrearon consigo la evolución general de otras ramas de la ciencia como la Meteorología, la Biología o la macroeconomía, requiriendo cada vez más nuevas vías de análisis más complejas y de interacción más variable, por lo que la IA volvió a retomarse, integrándose de nuevo en nuestras vidas, desde las predicciones del tiempo por Google, pasando por las nuevas superproducciones de animación y por los sistemas del Banco Central Europeo. También podríamos decir que gran parte de la IA se encuentra unida a la filosofía, existiendo pues ciertos temas particulares dentro de la misma, tales como ¿en qué consiste la inteligencia? ¿Es posible recrear una criatura compuesta por circuitos eléctricos y revestidos de metal, capaz de equiparar a un ser humano? ¿Tendría consciencia y emociones dicha máquina? Y suponiendo que pudiésemos crear dichas máquinas ¿sería legítimo o ético desarrollar tales hazañas? Como decíamos anteriormente, numerosas dudas acerca de la IA surgen día a día y empezamos a ver que el concepto de la IA es aun bastante difuso. Aunque teniendo en cuenta un punto de vista científico podríamos englobar a esta ciencia como la encargada de imitar el cerebro de una persona, en todas las funciones y acciones posibles existentes en un ser humano. Aunque si pensamos bien en la definición literal de IA, no cabe otra posibilidad que pensar en maquinas inteligentes, ajenas a cualquier tipo de emoción que enturbie el desarrollo y obstaculice la solución a un problema. Por los que deberíamos pensar en máquinas o dispositivos verdaderamente inteligentes, capaces de concluir o procesar millones de premisas a partir de otras premisas dadas, como las utilizadas en los sistemas de predicciones atmosféricas y que sean capaces de tomar decisiones por ellos mismos.

Lo cierto y verdad es que el misticismo creado por las películas de ciencia ficción han confundido el concepto de IA que la mayoría de nosotros tenemos respecto al descrito anteriormente, ya que lo que realmente nos gustaría es saber cómo sería ese dispositivo capaz de generar sus propias emociones tal y como los humanos hacemos, pero ¿Qué ocurriría si dotáramos a maquinas con ese instinto de supervivencia? ¿Estaríamos creando una nueva especie más inteligente y sofisticada que la propia naturaleza humana? Estas y miles de preguntas más podremos resolverlas en años venideros ya que actualmente todavía estamos muy lejos de encontrar una solución a todo esto.

ACTIVIDADES

- ¿Qué tipo de aplicaciones tenía, al principio, la Inteligencia Artificial?

- ¿Qué es un ser biotecnológico?

- ¿Qué cuestiones filosóficas acarrea la irrupción de la Inteligencia Artificial?

- ¿Piensas que en un futuro las máquinas podrían llegar a “pensar”?

- ¿Qué relación crees existe entre las películas de ciencia ficción y la Inteligencia Artificial?